Vous n’êtes pas sans savoir que le chatbot préféré du monde entier fait couler beaucoup d’encre ces dernières semaines. En tant qu’agence marketing, mais surtout en tant qu’êtres humains, nous nous devions de nous informer, d’analyser notre propre usage et de vous proposer un éclairage sur cet outil incroyable, dont les valeurs et les dérives ne sont pourtant pas franchement révolutionnaires.

Pour construire cet article, nous avons croisé diverses sources et consulté un expert du secteur : Eric Baroni, dirigeant d’une entreprise spécialisée en intelligence artificielle.

Une introduction rapide à l’IA

Mais avant d’entrer dans le vif du sujet, un rapide rappel du contexte pour celles et ceux qui n’auraient pas encore sauté le pas. ChatGPT est aujourd’hui le chatbot le plus utilisé au monde. En quelques années seulement, il est devenu incontournable. On l’utilise pour tout : optimiser ses tâches professionnelles, rédiger un devoir, dénicher la meilleure recette de pâtes carbonara ou encore concocter un programme de musculation pour qu’après quelques séances chez Basic-Fit, tu sois gonflé·e à bloc.

Contrairement à ce qu’on pourrait penser, ChatGPT n’est pas utilisé principalement pour le travail. Selon Business Insider, plus de 70 % des prompts adressés à ChatGPT n’ont rien à voir avec un usage professionnel. On lui demande de l’aide, des conseils, des idées… parfois même juste de discuter. Bref, on a vite l’impression qu’il peut répondre à tout, nous rassurer et nous épauler.

Il existe plein d’intelligences artificielles, classées en différents types. Celles sur lesquelles nous allons nous pencher sont appelées “génératives”. Pour citer une définition de la grande école du numérique, “L’intelligence artificielle générative est une catégorie d’IA qui se concentre sur la création autonome de contenu, tels que des textes, des images, des vidéos, des sons et d’autres types de données, par des systèmes informatiques. Ces systèmes utilisent des modèles avancés d’apprentissage automatique pour générer du contenu qui peut ressembler à ce qui est créé par des êtres humains.”

Il faut dire que ChatGPT a profondément transformé notre manière de chercher l’information, de structurer nos idées ou de produire du contenu. Ces nouveaux réflexes sont désormais ancrés dans nos habitudes, au point que l’on se demande souvent : « Mais comment faisait-on avant ? »

Biais algorithmiques et représentations sociales

Pourtant, l’IA n’est pas infaillible. Elle manque parfois de précision, hallucine des faits ou omet de citer ses sources. Même avec un prompt millimétré, la fiabilité à 100 % reste un mirage. Là où l’outil excelle véritablement, c’est ailleurs : reformuler, générer des concepts, synthétiser des documents ou offrir des pistes de réflexion. Bref, comme tout outil, ChatGPT a ses forces et ses limites.

Dès lors, la question s’impose : est-il sain de placer un seul chatbot au sommet de notre pyramide numérique ? OpenAI est-elle irréprochable sur le plan éthique ? Pourquoi devrions-nous remettre en question notre consommation de données ? Et surtout, pour une entreprise, est-ce un handicap stratégique de choisir de consommer « moins » d’IA, mais mieux ? Existe-t-il des alternatives crédibles ?

C’est ce que nous explorons dans ce Lijo Lab. La première partie décrit le contexte politique et éthique, tandis que la seconde s’attaque aux usages concrets et aux solutions de rechange.

Pour rappel, nos Lijo Labs s’appuient sur une recherche d’information rigoureuse, mais assument leur caractère éditorial. Nos conclusions reflètent nos convictions et nos combats. N’hésitez pas à partager votre avis avec respect !

Première partie : le contexte éthique et politique

Pourquoi chercher une alternative à ChatGPT ?

Depuis quelque temps, on voit émerger un mouvement de boycott autour de l’intelligence artificielle. Pour certain·es, c’est l’IA en général qui pose problème. Pour d’autres, la critique vise plutôt certaines entreprises précisément. Très souvent, c’est la plus connue de toutes qui se retrouve au centre des débats : ChatGPT, développé par OpenAI.

L’un des mouvements qui fait le plus parler de lui s’appelle QuitGPT. Cette initiative appelle les internautes au boycott de ChatGPT et revendique déjà plus de 4 millions de personnes ayant participé au mouvement. Selon Les Numériques, en un week-end (celui du 27 février 2026), l’intelligence artificielle la plus célèbre a vu son taux de suppression bondir de 295 %.

Sur le site de QuitGPT, on peut lire un message assez frappant :

« ChatGPT prend le contrat des robots tueurs de Trump. »

OpenAI et les robots tueurs : la fin d’une IA pacifique ?

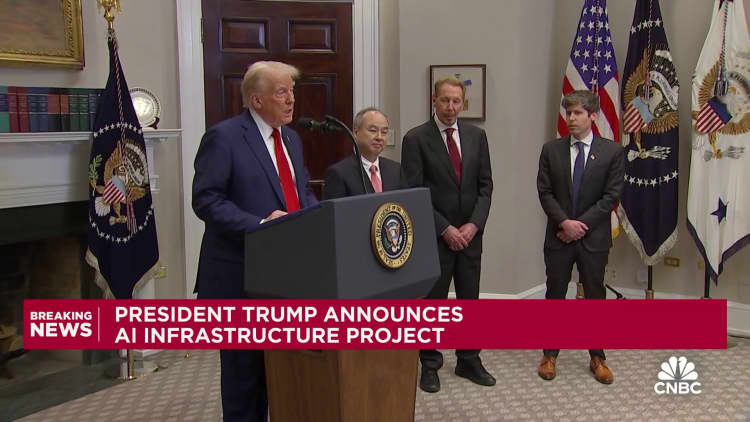

En résumé, OpenAI et sa direction ont adopté une ligne directrice très claire récemment. Ce virage stratégique se traduit par l’accord signé entre Sam Altman et le Pentagone, ouvrant l’accès aux modèles d’OpenAI au Département de la Défense des États-Unis. Là où son concurrent Anthropic préserve une posture de réserve vis-à-vis des applications militaires, OpenAI assume désormais une collaboration directe et volontaire.

Anthropic refuse de laisser le Pentagone utiliser ses outils « à toutes fins légales », sans limite garantie. Craignant particulièrement les dérives liées à la surveillance de masse. Si cette perspective est alarmante, elle s’inscrit néanmoins dans une forme de pragmatisme dictée par la conjoncture géopolitique actuelle, tout particulièrement aux États-Unis.

En effet, aussi inquiétant et digne d’un scénario à la Terminator que cela puisse paraître, les ambitions de la Défense ne se limitent pas à la surveillance, mais s’étendent au contrôle d’armes létales autonomes.

Après ce refus, la Défense américaine s’est tournée vers OpenAI, la firme derrière ChatGPT, qui a accepté de collaborer. Rien n’est encore certain, car les détails de cet accord demeurent confidentiels. Ce qui est certain, en revanche, c’est que cette collaboration apparaît moralement condamnable, surtout au regard des agissements du gouvernement Trump et de son Département de la Défense, que le président qualifie lui-même de «département de la guerre».

Si vous avez besoin d’une touche marketing

On ne le répétera jamais assez : faire preuve d’éthique, choisir ses combats et affirmer sa position n’est pas seulement un impératif moral ; c’est aussi un atout stratégique sur le long terme, notamment auprès du grand public. Alors bien sûr, il ne faut jamais instrumentaliser des causes pour se donner une belle image. Mais il ne faut pas non plus renoncer à se positionner par peur du contrecoup, bien au contraire !

Anthropic est bien évidemment loin d’être une entreprise parfaite : les enjeux économiques et la vision capitaliste des investisseurs prennent souvent le pas sur la responsabilité sociale. Mais quand une décision va dans le bon sens, il est essentiel de le souligner.

Pourquoi ChatGPT est-il perçu comme un « allié de Trump » ?

Vous pensiez que la relation entre Trump et OpenAI s’arrêtait à une simple proximité ? Loin de là. Devinez qui est devenu l’un des plus grands donateurs de Trump avec un don de 25 millions de dollars : Greg Brockman, cofondateur et président d’OpenAI. Bon, il n’est pas le seul : le sujet des financements est très intéressant et complexe. On vous ramène vers un contenu de Gaspard G, qui a réalisé une chouette vidéo sur le sujet.

En septembre dernier, le président d’OpenAI a bel et bien versé la somme astronomique de 25 millions de dollars à « MAGA Inc. », le super PAC (un organisme de financement de campagne) qui soutient Donald Trump. L’objectif de l’entrepreneur est limpide : s’attirer les faveurs de l’administration pour obtenir des réglementations plus permissives et des investissements massifs. Si le lobbying est monnaie courante chez les capitaines d’industrie, ce don représente 25 fois le montant versé par n’importe quelle autre entreprise du secteur de l’IA. Faut-il pour autant sacrifier nos idéaux d’équité sur l’autel du profit ?

De plus, GPT-4 d’OpenAI serait l’outil utilisé par l’ICE, la police de l’immigration, pour trier les dossiers et les CV et donc aider à l’embauche de nouveaux policiers. Tout cela rend centrale la question de la contribution des entreprises d’IA à la montée de l’autoritarisme et de la menace qu’elles pourraient représenter pour la démocratie.

Le poids politique et éthique : l’IA comme outil d’influence

Aujourd’hui, utiliser ChatGPT, c’est alimenter directement la puissance financière de dirigeants qui financent activement le recul des droits des femmes et des minorités LGBTQ+. C’est subventionner une police migratoire aux méthodes inhumaines, responsable de la séparation de familles et de victimes innocentes. C’est, enfin, cautionner une politique étrangère qui piétine délibérément le droit international.

Loin de toute culpabilisation stérile, il s’agit d’une prise de conscience nécessaire : nos choix technologiques sont des actes politiques. Dans un monde où l’information est à portée de clic, l’ignorance n’est plus une excuse, elle devient une complicité.

Si nous nous sommes focalisés sur le positionnement politique d’OpenAI, le débat autour de l’intelligence artificielle dépasse largement ce cadre. Biais algorithmiques, désastre écologique ou déshumanisation des rapports sociaux : les griefs sont nombreux.

Mais qu’en pensons-nous réellement ? Vous l’aurez compris, les orientations de la firme ne sont pas alignées avec nos combats. Loin de tout jugement moralisateur, notre démarche est celle de la transparence et de la vigilance. Il n’est jamais aisé de bouleverser ses habitudes, surtout dans un cadre professionnel. Pourtant, pour toute entité intégrant l’IA, l’innovation ne doit jamais servir de prétexte à l’abdication éthique.

Soyons honnêtes : chez Lijo, nous utilisons aussi ChatGPT pour structurer ou corriger nos contenus. Et à l’instar de cette amertume que l’on ressent face à un artiste que l’on admire mais que l’on ne peut plus cautionner, il est profondément frustrant de constater que les outils qui nous facilitent la vie sont portés par des valeurs qui nous révoltent.

La problématique de la souveraineté numérique et des données

C’est le sujet chaud du moment, « la souveraineté numérique ». Beaucoup d’entreprises et de pays se doivent d’avoir une confidentialité absolue dans le traitement de leurs données, tant au niveau stratégique qu’au niveau du respect de la vie privée.

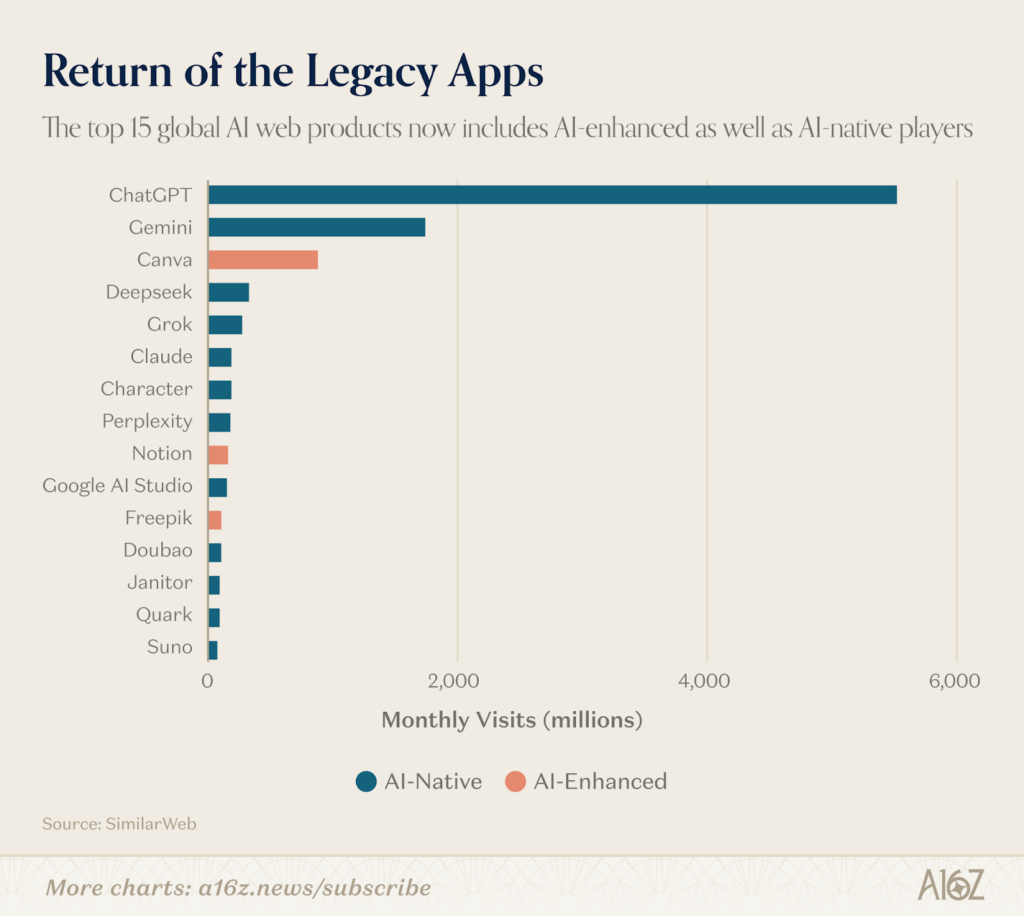

Le nouveau top 100 d’Andreessen Horowitz confirme un constat sans appel :

Dépendance technologique : le risque des modèles américains

La domination mondiale des IA génératives est exclusivement américaine ou chinoise. Même si des pays comme la France ou l’Allemagne s’intéressent de plus en plus au développement de ces solutions, les États-Unis restent aujourd’hui le pays qui investit le plus dans ce domaine, avec les IA les plus utilisées au monde.

Nous n’avons rien de personnel contre cette partie du monde, mais la situation géopolitique de ces derniers mois a sérieusement ébranlé l’acceptation de l’Europe et de ses citoyens à laisser le monopole technologique aux USA, par exemple.

Des tendances virales comme le « starter pack » ou « Ask ChatGPT to roast you » semblent anodines. Pourtant, chaque interaction génère une mine d’informations sur l’utilisateur et son environnement. Le problème est structurel : ces données sont stockées sur des serveurs soumis à des législations étrangères, souvent incompatibles avec le RGPD européen. En clair, vos informations deviennent, de fait, la « propriété » de ces juridictions.

Cela soulève des enjeux critiques :

En cas de piratage ou d’exploitation malveillante de serveurs américains, que deviendraient vos données biométriques (voix, visage) ou vos cercles privés ? Le risque d’usurpation d’identité à grande échelle est une menace bien réelle.

La réglementation comme vecteur d’innovation les solutions d’intelligences artificielles

Au niveau économique, beaucoup de professionnels utilisent l’IA de manière intensive. Imaginez si vos stratégies, vos documents confidentiels ou même vos identifiants et mots de passe étaient partagés ou utilisés ? Il en résulterait un danger concurrentiel majeur.

Les autres continents ne sont pas parfaits, mais soutenir des entreprises européennes, par exemple, c’est aussi soutenir un autre modèle technologique : des règles souvent plus strictes en matière de protection des données et d’impact écologique, une volonté de régulation démocratique et, tout simplement, l’idée que l’innovation ne doit pas être monopolisée par la Silicon Valley.

Et nous vous laissons méditer sur une question : la régulation n’est-elle pas justement vectrice d’innovation ?

Nous avons posé la question à Eric Baroni, co-CEO de Multios, entreprise technologique, et voici sa réponse :

« J’affirme catégoriquement que la réglementation ne freine jamais l’innovation, mais l’encadre. Le cadre réglementaire européen, malgré sa complexité certaine, est essentiel et ne fait que sublimer l’innovation.

Pour qu’une entreprise soit souveraine, les données et les calculs doivent rester sur ses propres serveurs, ce qui exclut de facto l’utilisation de services génériques externes comme ChatGPT, Claude et potentiellement Mistral AI. »

L’enjeu ne réside donc pas seulement dans l’outil, mais dans notre manière de l’utiliser. C’est dans cette réappropriation de nos usages que se jouent notre souveraineté et nos responsabilités sociales et écologiques.

Deuxième partie : utilisation et alternatives

Boycotter ChatGPT : est-ce la seule alternative ?

Après ce « petit » contexte, il apparaît clairement que l’essentiel réside d’abord dans notre manière d’appréhender l’IA : s’éduquer sur les coulisses des algorithmes et affirmer des positions alignées avec nos valeurs. Faut-il pour autant se contenter de boycotter ChatGPT au profit d’une solution européenne ? Malheureusement, la réalité est plus nuancée. Les alternatives ne sont exemptes ni de défauts moraux ni de limites opérationnelles. Chaque outil possède ses propres spécificités, tant au niveau de ses fonctionnalités que de l’éthique de l’entreprise qui le façonne.

Si l’IA peut indéniablement améliorer notre confort de vie, son utilisation à outrance devient problématique. Certains problèmes sont en effet bien réels : confidentialité des données, reproduction de biais systémiques, menaces sur l’emploi ou encore isolement social. Sans oublier l’empreinte écologique colossale de ces technologies, dont la consommation énergétique est vertigineuse.

Se dire « Je quitte ChatGPT » reste une démarche que l’on ne peut que saluer mais la solution la plus pérenne consiste à s’interroger sur nos besoins réels : « Dans quelles circonstances l’IA est-elle indispensable ? » et « Quelles technologies sont véritablement compatibles avec mes principes ? », que ce soit dans la sphère privée ou professionnelle.

Avant d’aller plus loin, on voulait faire un petit coup de gueule sur la 4e IA la plus utilisée selon Andreessen Horowitz : Grok.

Lancée en 2023, cette dernière est développée par xAI, et donc par Elon Musk. Grok est clairement positionné politiquement, adepte de la désinformation, et fait les éloges de son créateur à la moindre occasion… et plein d’autres trucs absolument inacceptables. En vrai, même pas besoin de vous dire pourquoi on vous la déconseille : il suffit de taper le nom du monsieur, ou celui de son IA, avec le mot « polémique » dans votre navigateur pour comprendre. (Signe douteux et tout le tralala). Voilà qui est dit, continuons.

IA et Éthique : Comment choisir un outil responsable ?

Non. Nous ne sommes pas partisans de la disparition d’une innovation aussi majeure. Mais comme pour tout outil puissant, il s’agit d’apprendre à l’utiliser avec discernement et parcimonie.

Prenons deux exemples concrets :

En tant qu’individu : Pour protéger notre planète, nous avons appris à trier nos déchets. C’est bénéfique pour nos ressources et cela optimise le recyclage. Cependant, trier n’aurait aucun sens sans une réflexion sur notre manière de consommer. C’est pourquoi nous choisissons de réduire le plastique ou d’acheter en vrac. C’est là que l’éducation citoyenne prend tout son sens : objectivement, il serait bien plus simple de tout jeter dans un sac poubelle unique par pure paresse.

En tant qu’entreprise : une boite doit générer des revenus, et donc optimiser ses process. L’IA permet aujourd’hui d’accomplir plus rapidement des tâches autrefois chronophages (recherche, analyses, révisions, textes, etc). Mais si l’entreprise n’encadre pas l’utilisation de l’outil, tous les membres de celle-ci laisseraient petit à petit l’intelligence artificielle prendre le pas sur la projection et la créativité de tous projets. Par définition, une IA générative n’est pas créative : elle est statistique. Si on lui laisse le plein contrôle, chaque réponse devient uniforme, lissée, et finit par tuer toute innovation. La solution ? Que chaque département utilise des outils spécifiques pour décupler sa productivité à des moments clés du projet.

Objectivement, tout déléguer à ChatGPT est la solution de facilité. Mais utiliser l’IA de manière responsable, c’est refuser de l’interroger pour le moindre doute ou pour une recette de cuisine. Pour ces usages simples, les moteurs de recherche classiques remplissent parfaitement leur rôle tout en consommant beaucoup moins d’énergie.

Guide pratique : À chaque besoin son outil d’IA

D’un point de vue purement opérationnel, si ChatGPT s’impose comme le chatbot le plus polyvalent pour les tâches générales, il est souvent plus pertinent de privilégier des IA spécialisées pour des besoins précis.

Certes, la force de ChatGPT réside dans sa nature holistique : son interface unique mobilise une multitude de modèles complexes pour répondre à n’importe quelle requête. On pourrait se dire : « Tant mieux si un seul outil peut tout faire. » Pourtant, cette omni-compétence a un coût invisible mais colossal.

Prenez l’exemple de la traduction : solliciter ChatGPT pour traduire un texte consomme 15 à 20 fois plus d’énergie que de passer par un outil dédié comme DeepL. Au-delà de cet impact écologique, le résultat fourni par une IA spécialisée sera, dans la majorité des cas, bien plus fiable et nuancé.

C’est précisément là que nos choix individuels et professionnels prennent tout leur sens. Optimiser ses usages, c’est savoir quel outil correspond à quel besoin pour ne pas gaspiller de ressources inutilement.

Plus que de simplement vous encourager à tester des solutions européennes (souvent plus respectueuses de votre vie privée et plus affûtées sur vos problématiques), nous vous invitons surtout à trouver le juste équilibre entre intelligence humaine et assistance artificielle. L’IA doit rester un levier de précision, et non un réflexe par défaut.

Les meilleures alternatives à ChatGPT selon vos usages

Aleph Alpha : la pépite allemande pour les pros

On ne la connaissait pas, cette startup allemande fondée en 2019 partage des valeurs assez similaires à celles d’autres solutions européennes : transparence, protection des données (conformité RGPD) et alignement éthique. L’entreprise met clairement en avant la souveraineté européenne et la responsabilité dans le développement de l’intelligence artificielle. Elle insiste aussi sur le fait d’éviter au maximum les transferts de données hors de l’Union européenne.

Ici, Luminous, la famille de modèles de langage développée par Aleph Alpha, adopte une approche beaucoup plus professionnelle. L’entreprise met clairement en avant son intérêt à travailler avec des entreprises et des organisations publiques, plutôt que de nous assister sur des petits besoins de la vie de tous les jours.

C’est donc moins à Luminous que tu demanderas de te faire un programme pour devenir la version la plus fit de toi-même. Par contre, il peut vraiment t’épauler pour les tâches que tu réalises au travail. Les modèles d’Aleph Alpha sont, par exemple, conçus pour analyser des documents complexes, résumer des rapports ou traiter de grandes quantités de textes. L’IA est également très performante en multilingue, ce qui la rend particulièrement utile pour les organisations qui travaillent à l’international.

Leur technologie est d’ailleurs déjà utilisée par certaines institutions et entreprises européennes, notamment pour des tâches qui demandent une grande précision, comme l’analyse de documents juridiques ou administratifs. Aleph Alpha excelle dans les applications complexes et spécifiques pour des secteurs comme la fabrication, le juridique et le médical.

Si vous avez reconnu vos besoins dans cette petite description, allez tester Aleph Alpha !

Euria : une nouveauté ultra-éthique

Plus pertinente encore pour nos besoins, Euria a été présentée au public fin 2025 par Infomaniak. Oui, elle est véritablement toute neuve, mais elle s’impose déjà comme l’IA la plus éthique et responsable à laquelle on ait pensé. Infomaniak est un hébergeur suisse réputé pour son engagement indéfectible en faveur de la vie privée et de l’écologie.

Euria partage les mêmes valeurs que les solutions précédentes, mais elle pousse le curseur encore plus loin : souveraine, éthique, écologique et 100 % européenne. Soumise à des réglementations ultra-strictes, elle garantit qu’aucun transfert de données n’est réalisé hors de Suisse. Mieux encore : vous pouvez sélectionner un mode éphémère pour qu’absolument rien ne soit enregistré après votre session.

Ce qui est sans doute le plus innovant avec cette IA, c’est sa manière de traiter la chaleur dégagée par ses serveurs. Au lieu de consommer des quantités astronomiques d’eau pour le refroidissement, comme le fait ChatGPT, Euria récupère cette énergie thermique pour chauffer des logements à Genève. De plus, ses datacenters fonctionnent exclusivement aux énergies renouvelables. Cette initiative, aussi ingénieuse que révolutionnaire, ouvre une voie très prometteuse pour l’industrie.

En termes d’efficacité, le modèle est encore récent ; sa montée en puissance se mesurera sur le long terme. Des mises à jour régulières viennent toutefois muscler ses performances. Pour une utilisation privée ou professionnelle (analyse de documents, rédaction ou recherche classique), elle remplit parfaitement sa mission.

Certes, elle n’égale pas encore certains géants sur les tâches les plus techniques et complexes, mais elle est déjà pleinement opérationnelle pour votre quotidien. Nous pensons qu’il est crucial de la soutenir : face à une concurrence aussi féroce, une telle prise de position mérite d’être saluée. Alors pour vos recettes, vos e-mails ou vos reformulations, adoptez le réflexe Euria 😉 (C’est gratuit).

Black Forest Labs : Créez des visuels de ouf

Certain·es d’entre vous ont sûrement déjà pris le pli de modifier des images avec ChatGPT, par exemple pour supprimer un déchet sur le trottoir d’une photo presque parfaite pour Instagram, ou pour créer des visuels pour des projets scolaires ou des présentations. Eh bien sachez que cette IA allemande fondée en 2024 fait ça comme une pro.

À partir de simples prompts, Black Forest Labs génère des images de qualité tout à fait utilisables dans un contexte professionnel. Son modèle principal, appelé FLUX (une famille de modèles de génération d’images), permet de créer des visuels réalistes à partir d’une description, mais aussi de retoucher des images, modifier leur style ou générer de nouvelles créations.

Les fondateur·rices de Black Forest Labs ont d’ailleurs travaillé auparavant sur Stable Diffusion, l’un des modèles d’images génératives les plus connus au monde, ce qui explique en partie la qualité et la précision des résultats.

Si vous êtes designer, dans le marketing, ou simplement créatif·ve, l’outil est particulièrement intéressant. Il permet notamment d’utiliser plusieurs images de référence simultanément afin de maintenir une cohérence visuelle, ce qui est crucial pour les projets créatifs.

Les images générées peuvent atteindre une qualité professionnelle, et la plateforme propose une approche hybride, adaptée aussi bien aux particulier·ères qu’aux entreprises. Comme Aleph Alpha et Euria, l’entreprise s’inscrit également dans une logique de souveraineté européenne.

En résumé, si ton objectif est de générer ou modifier des images avec une IA puissante et flexible, Black Forest Labs est l’IA européenne faite pour toi.

MAIS ATTENTION, ne génère pas d’image si tu n’en as pas besoin, cela consomme énormément, et puis ton smartphone le fera très bien !

Nous ne l’avons pas testé. La création pure de visuels ne se fait pas via l’IA avec l’agence.

DeepL : Le boss de la traduction

Ahh, ça nous rappelle des souvenirs. Avant l’arrivée des Chats IA, Deepl était le site utilisé pour des traductions expresses. Mais ce n’est pas qu’une vieille solution, c’est pour cela qu’elle est notre dernière alternative.

Selon nous, c’est un énorme exemple de notre consommation actuelle : pourquoi irions-nous sur Deepl alors que ChatGPT sait traduire pour moi ?

Cette solution vous propose une traduction bien plus naturelle et logique que Google Trad. (On parle d’expérience, ayant traduit presque tous nos devoirs de néerlandais dessus).

Tout ça pour dire que son niveau convient parfaitement aux particulier·ères, aux étudiant·es, aux professionnel·les et aux entreprises. Selon de nombreuses sources, DeepL est même souvent considéré comme le meilleur outil de traduction de tout Internet. Et ce n’est pas un hasard : c’est aujourd’hui l’une des IA européennes les plus utilisées, souvent citée juste derrière Mistral AI (la queen des IA européennes, on en parle après).

Et cerise sur le gâteau : c’est une entreprise conforme au RGPD, avec des données protégées et des standards de sécurité professionnels, qui met en avant des valeurs fortes de respect de la vie privée. C’est donc clairement une alternative européenne solide pour la communication multilingue.

Alors si vous devez traduire quoi que ce soit, ne demandez plus à ChatGPT… allez sur DeepL !

Mistral AI : La queen des IA européennes

Bon, on l’a dit, “juste quitter ChatGPT” n’est pas suffisant, mais nécessaire.

Fondée en 2023 à Paris, Mistral AI est une startup française spécialisée dans le développement de modèles de langage avancés (LLM). L’outil représente alors une alternative performante, avec des standards éthiques parmi les plus stricts du marché.

Quels sont ces standards ?

- Première solution IA à avoir communiqué sur son impact écologique.

- Mistral AI met l’accent sur la protection des données, avec sa conformité au RGPD, l’innovation responsable et l’accessibilité, tout en garantissant une technologie de pointe et en constante évolution.

- Elle propose un hébergement local et un cloud souverain.

- L’entreprise a également une politique rigoureuse concernant l’éthique et l’impact de ses technologies.

Mistral AI est d’ailleurs en train de devenir un acteur clé de la souveraineté numérique européenne : la France et l’Allemagne ont annoncé vouloir collaborer avec l’entreprise pour développer une IA destinée à leurs administrations publiques.

Un autre truc sympa, le chat est aussi facilement personnalisable et s’adapte aisément au ton que vous lui demandez.

Vous vous en doutez, plus de régulation et moins d’utilisateurs font que le développement est encore en cours et peut aller “moins vite” qu’avec d’autres solutions. Tout n’est donc pas rose, mais on préfère se dire qu’un développement responsable et réfléchi, ça en vaut la peine.

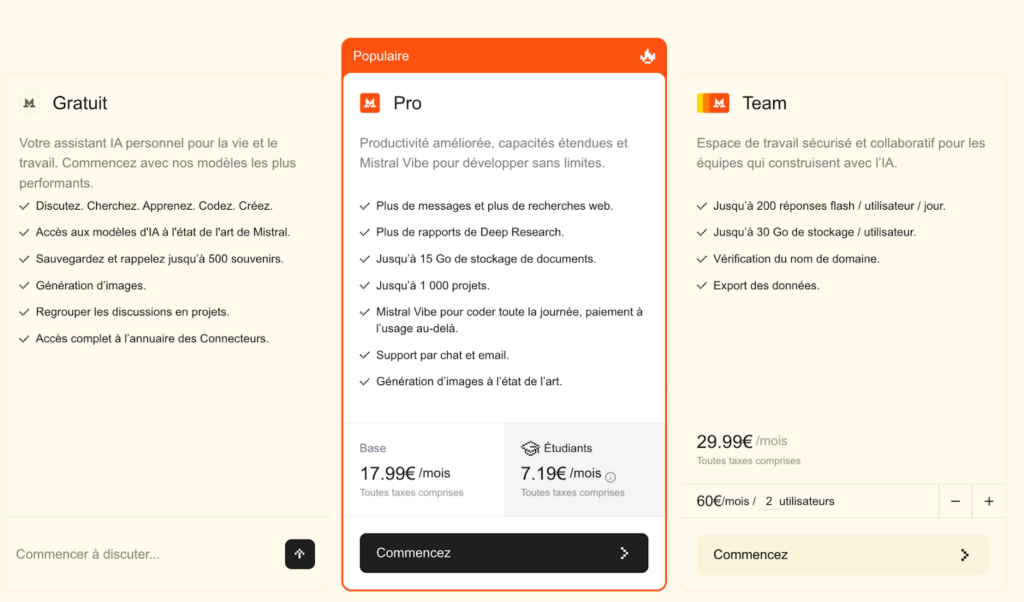

Selon les 3 plans proposés (nous parlons ici du chat de Mistral IA), plusieurs fonctionnalités et limites sont associées.

Du coup, qu’en pensons-nous ?

C’est la seule solution alternative que nous avons profondément testée. Et nous allons la garder. L’interface est vraiment sympa et les réponses cohérentes. Si votre utilisation de l’intelligence artificielle est purement opérationnelle (reformulation de textes, orthographe, réponses à des requêtes, etc.), vous pouvez switcher de manière responsable les yeux fermés.

Conclusion : Le bon sens, clé d’une IA maîtrisée

Alors, doit-on réellement quitter ChatGPT ? Après avoir posé le décor, une évidence s’impose : en tant que professionnel et citoyen, il est devenu vital de s’éduquer et de rester vigilant face au positionnement des ntreprises qui façonnent notre quotidien.

En ce mois de mars 2026, les États-Unis sont en train de rompre avec leurs propres principes démocratiques. Ce séisme nous force à mesurer l’ampleur du problème : notre dépendance technologique totale envers des régions dont nous ne partageons plus les valeurs. Des appels au boycott sont lancés, des dénonciations éclatent… mais au final, qu’en est-il vraiment ?

Vers une utilisation consciente et souveraine

Changer ses habitudes, c’est compliqué, surtout quand elle vous simplifie la vie. Et puis, il ne faut pas tomber dans l’ultra jugement, ou au contraire faire du semblant social, pour paraître beau et trendy. L’intelligence artificielle pose des problèmes, comme toutes les innovations. Ceux éthiques, comme un positionnement douteux ou une reproduction de biais et stéréotypes discriminants, entre autres, peuvent être contrés grâce à l’éducation et le choix d’autres solutions. Mais il existe également des problèmes plus compliqués, liés à l’existence même de l’IA. Le coût énergétique en est un parmi d’autres.

Au fil de cet article, nous avons compris que le boycott seul ne suffisait pas. Il doit s’accompagner d’un premier pilier : notre responsabilité d’usage. Si chaque individu se limitait aux requêtes strictement nécessaires, et si les professionnels utilisaient l’IA avec parcimonie, une grande partie des nuisances seraient contenues, le temps que l’innovation énergétique nous rattrape.

Mais ce processus demande du courage, de l’intelligence et surtout du dévouement (comme la conscience écologique). Car le vrai danger, c’est que nous ne subissons pas encore les conséquences de notre utilisation abusive de l’intelligence artificielle générative. Encore un chouette cadeau pour un futur toujours plus craignos.

C’est pour cela qu’un second facteur entre en jeu : « un besoin = un outil ».

Choisir son IA, c’est voter pour un futur

La réponse à « Dois-je trouver une alternative à ChatGPT ? » commence enfin à s’écrire. Pour le privé, un boycott ou une diminution drastique des requêtes ne changera pas votre vie. Pour les pros, il reste souvent l’excuse de la compétitivité. Mais cette excuse ne tient plus.

Après avoir discuté avec Éric Baroni, nous avons porté une attention particulière au contexte d’utilisation. On s’explique : ChatGPT est une IA holistique. Pour vous répondre, elle doit « réfléchir » globalement, mobilisant une puissance immense même pour une tâche simple comme une traduction. À l’inverse, une intelligence spécialisée comme DeepL générera une réponse ciblée et instantanée. ChatGPT, c’est comme si votre cerveau devait fouiller dans chaque recoin de sa mémoire pour se rappeler un détail de la veille : ça consomme énormément d’énergie.

Vous voyez le paradoxe ? Utiliser des solutions adaptées à des besoins spécifiques, c’est envoyer valser notre vieille excuse de la performance. Vos réponses seront plus compétitives, plus rapides et, surtout, plus responsables.

Comme nous aimons le répéter à nos clients : la com’, le marketing et la vie, c’est avant tout une question de bon sens et de remise en question.

Bref, ChatGPT reste une innovation de dingue, mais il est temps de faire des choix intelligents. L’IA est un outil de puissance, et comme un vieux sage nous l’a appris : « Un grand pouvoir implique de grandes responsabilités. » Cette phrase n’a jamais été aussi brûlante d’actualité. Aujourd’hui, nous avons tous l’occasion de devenir les héros et héroïnes de notre propre transition numérique. Ne la ratons pas !